-

Products

-

Studio

Un studio pour construire à la pointe.

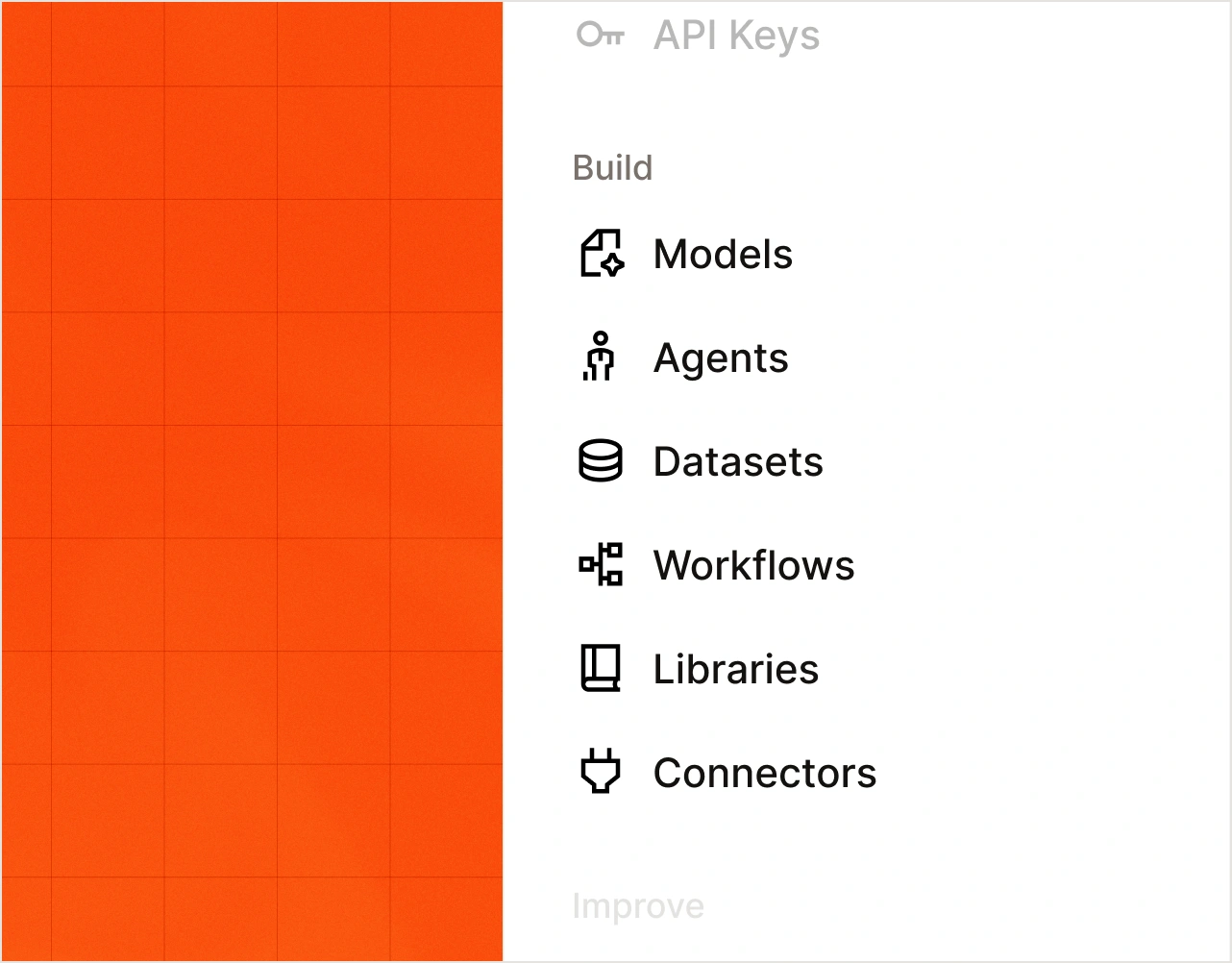

Construire.

Connectez vos sources de données. Orchestrez votre logique métier. Déployez une IA fiable en conditions réelles.

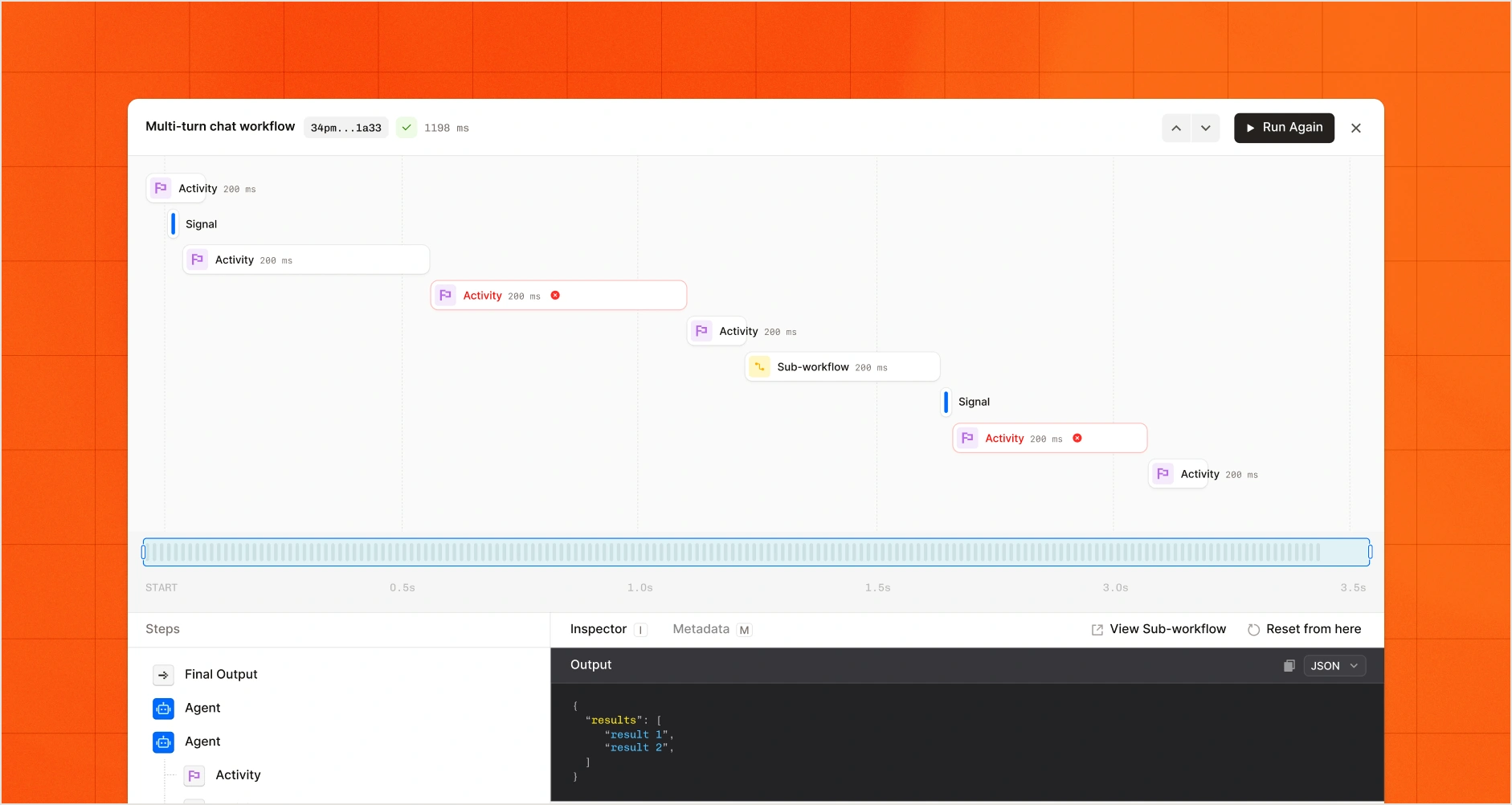

Workflows.

Orchestrez des processus agentiques qui conservent l’état, réessayent en cas d’échec et reprennent automatiquement.

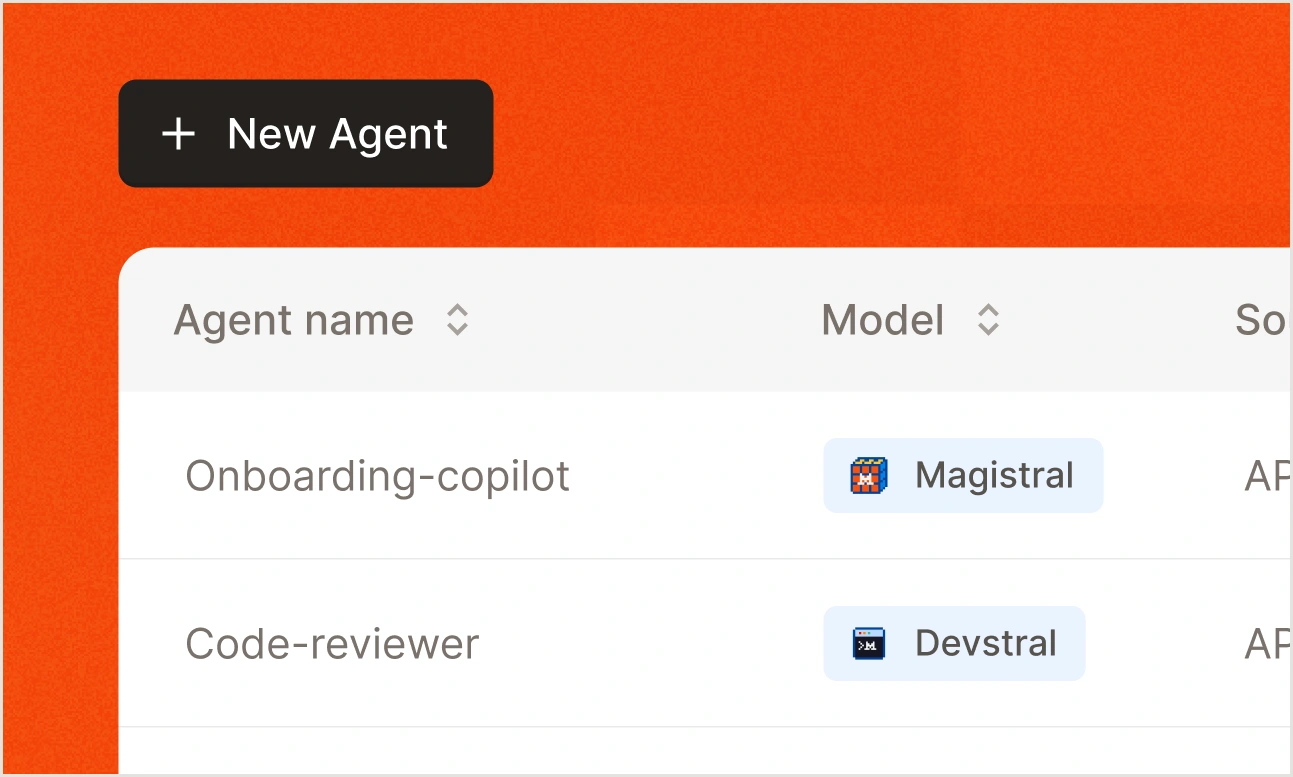

Agents.

Concevez des agents IA qui raisonnent sur des outils, des données et des systèmes. Définissez des instructions et contrôlez leur comportement avant la production.

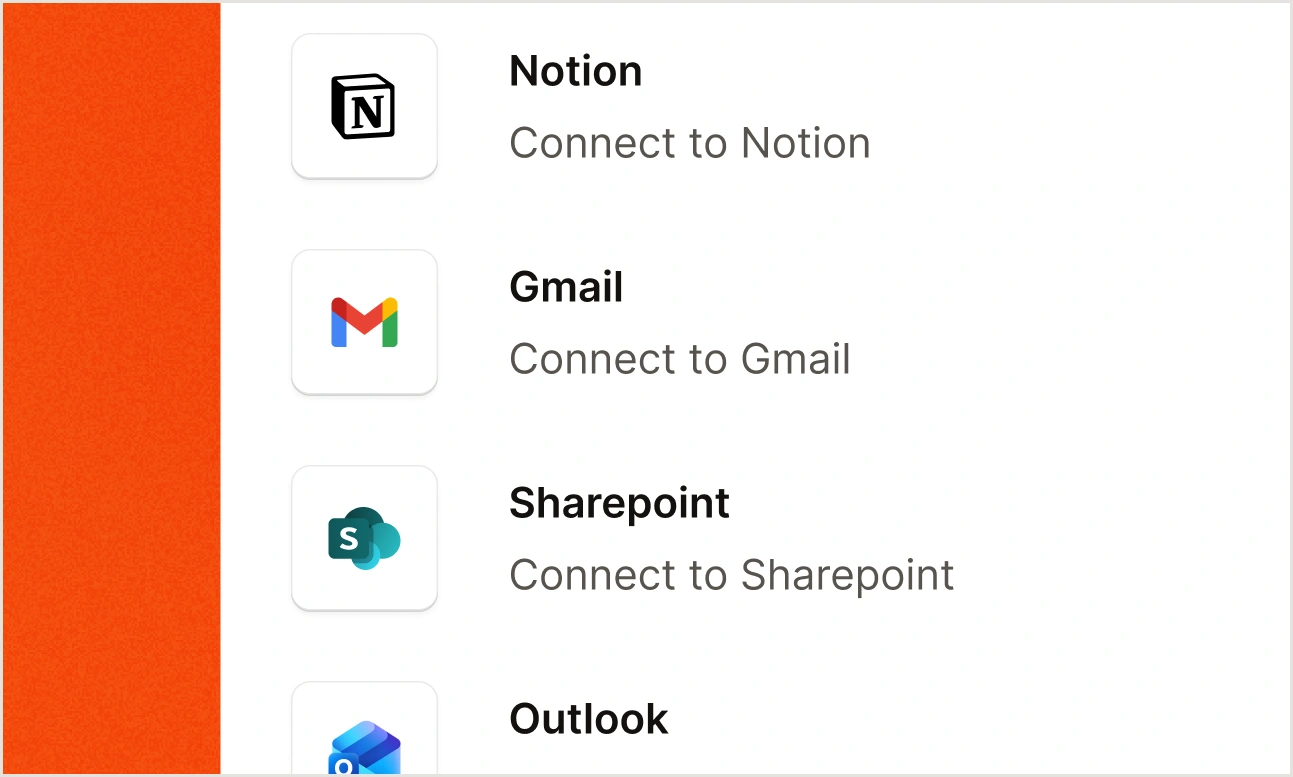

Connecteurs.

Connectez-vous à toute source de données d’entreprise avec des connecteurs intégrés ou personnalisés. Construisez une fois, réutilisez partout.

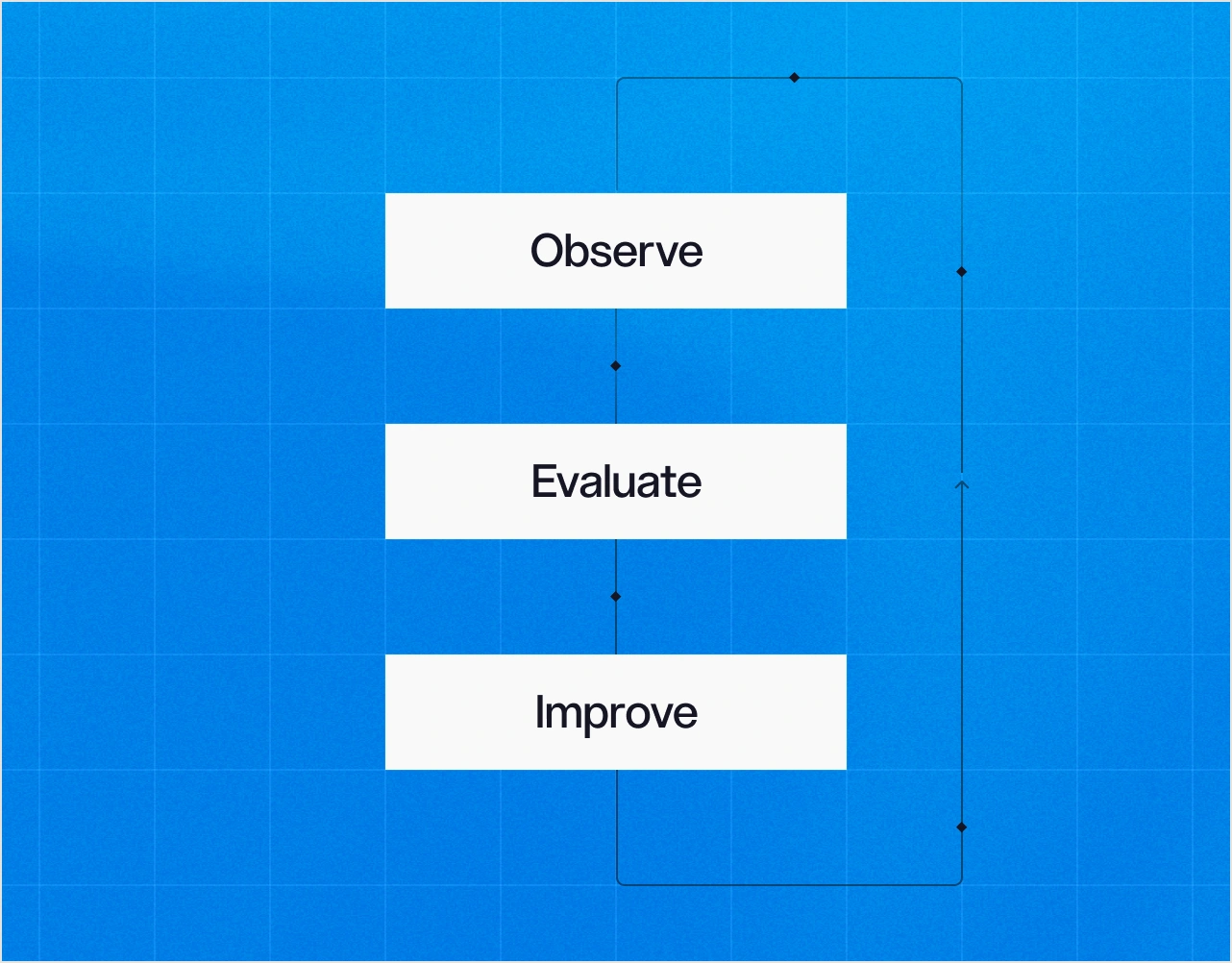

Itérez.

Mesurez ce que votre IA fait réellement. Puis améliorez-la.

Expériences.

Concevez et comparez des variations de modèles dans des environnements contrôlés. Testez les modifications avant qu’elles n’atteignent les utilisateurs.

Campagnes.

Exécutez des itérations reproductibles et versionnées. Suivez les changements, les améliorations et les régressions.

Évaluateurs.

Notez automatiquement les résultats avec des modèles d’évaluation intégrés ou personnalisés. Remplacez les revues subjectives par des métriques cohérentes et interprétables.

Jeux de données.

Transformez le trafic réel et les retours de production en données d’entraînement curatées. Chaque interaction devient une opportunité d’amélioration.

Déployez.

Exécutez partout. Votre infrastructure, vos règles.

Hybride.

Déployez sur des environnements cloud et on-premise avec un comportement cohérent. Un seul codebase, pour toute infrastructure.

Dédié.

Isolez les charges de travail pour la sécurité, la conformité ou les performances. Environnements séparés, sans ressources partagées.

Auto-hébergé.

Conservez un contrôle total sur l’infrastructure et la localisation des données. Rien ne quitte votre périmètre.

Gouvernance.

Visualisez tout. Contrôlez ce qui compte.

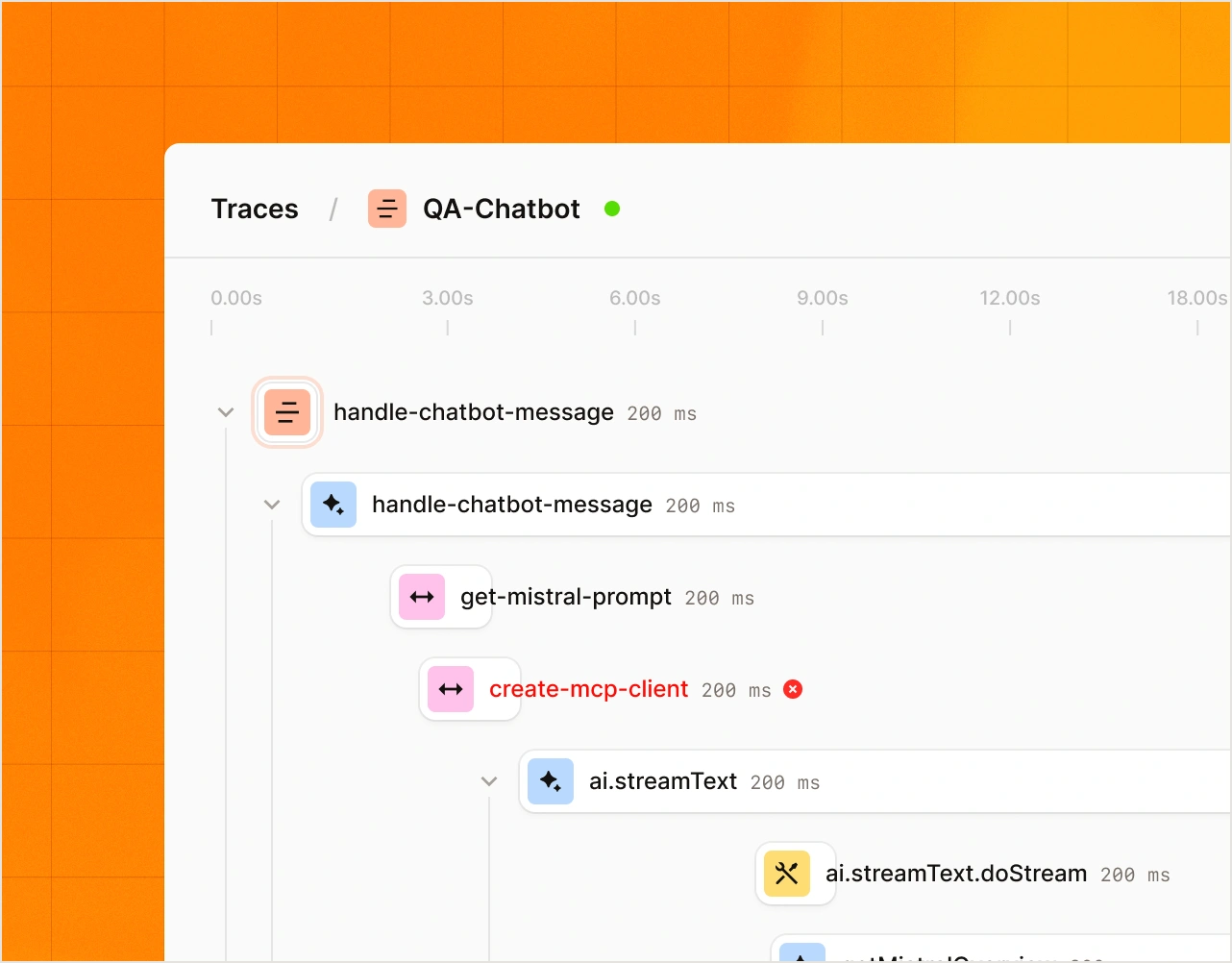

Observabilité.

Visualisez chaque requête, réponse et décision dans des pipelines multi-étapes. Traces, tableaux de bord et graphiques de contexte en temps réel.

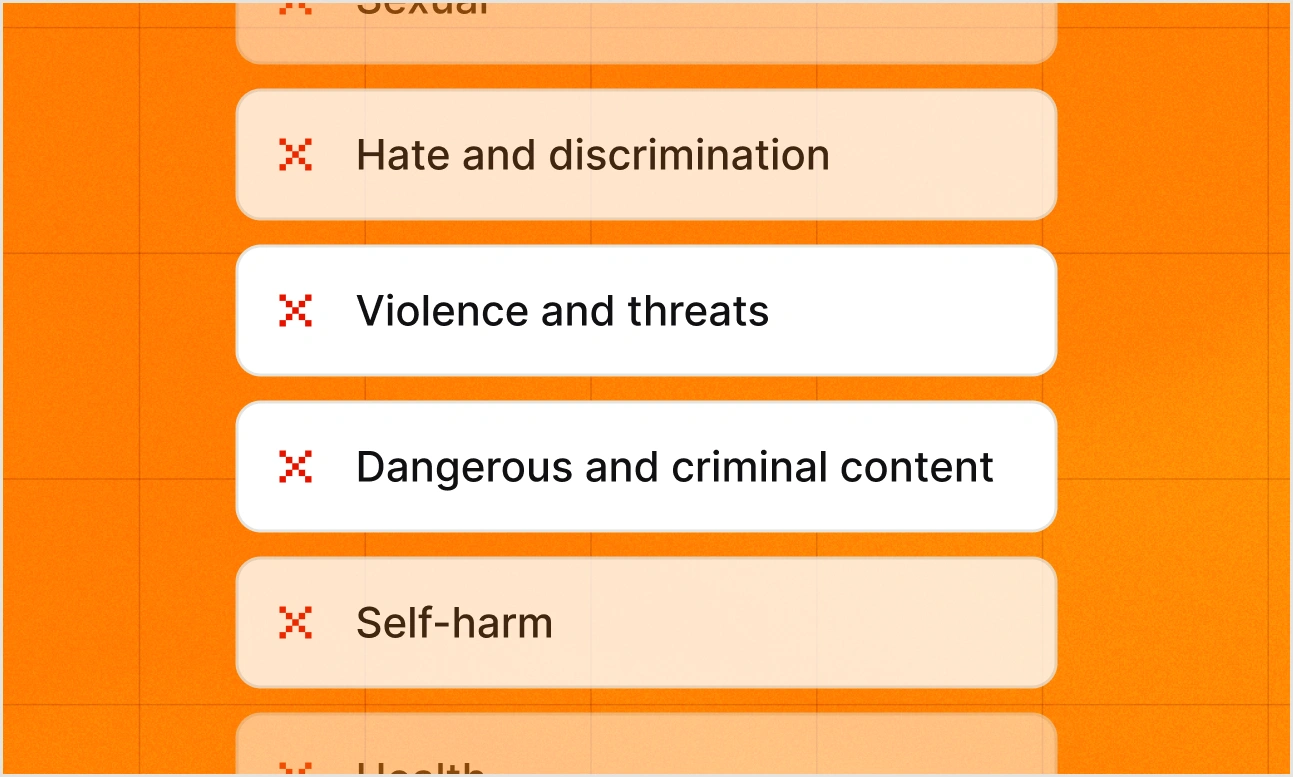

Gardes-fous.

Appliquez des contraintes comportementales et stratégiques à l’exécution. Définissez ce que votre IA peut ou ne peut pas faire, en code.

Modération..

Détectez et filtrez automatiquement les sorties non sûres ou non conformes. Les politiques s’appliquent à chaque réponse.

Accélérez.

Le premier cas d’usage IA peut être chronophage. Les 10 suivants ne devraient pas l’être.

Registre IA.

Un catalogue unifié pour les modèles, agents, jeux de données et workflows. Traçabilité complète et contrôles d’accès, le tout au même endroit.

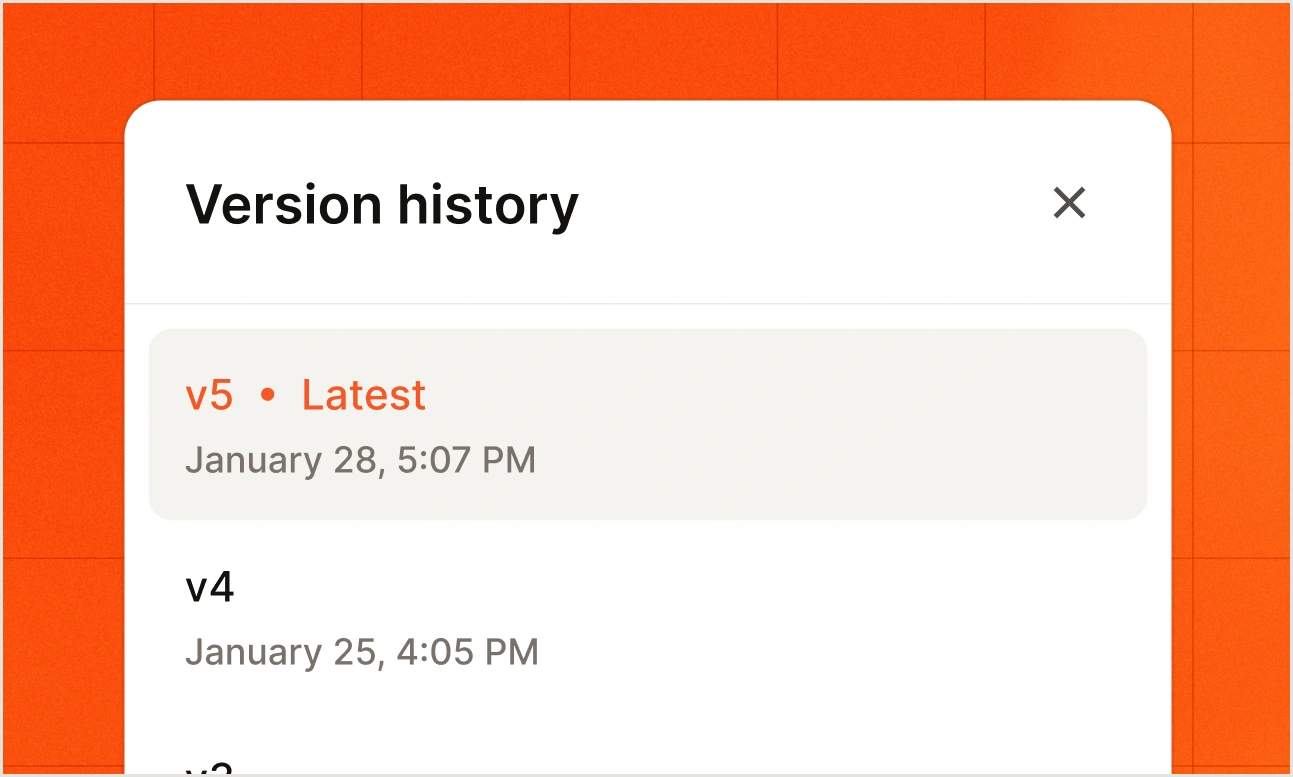

Versions et traçabilité.

Suivez chaque modification entre les équipes. Réutilisez les actifs en toute confiance. Revenez en arrière instantanément si nécessaire.

Toolkit pour développeurs.

API, SDK, exemples de code et composants pré-construits. Tout ce dont vous avez besoin pour commencer à construire en quelques minutes.

Construisez les technologies et services de demain.

Documentation.

Guides complets et références API.

Exemples

Exemples de code prêts à l’emploi et tutoriels.

Support.

Connaissances et ressources communautaires.

Services.

Accompagnement expert pour des solutions sur mesure.